「画像に透かしを入れる」と聞くと、人間が制作したコンテンツの転載や悪用を防ぐためのものだと認識している人が多いかもしれませんが、近年はAIが生成したコンテンツに透かしを入れて帰属を示す試みも進行中です。新たに、AIが生成した画像を追跡可能にする「Tree-Ring Watermarks(年輪透かし)」という技術を、メリーランド大学の博士課程でコンピューターサイエンスを研究しているユーシン・ウェン氏らが発表しました。

[2305.20030] Tree-Ring Watermarks: Fingerprints for Diffusion Images that are Invisible and Robust

https://arxiv.org/abs/2305.20030

GitHub – YuxinWenRick/tree-ring-watermark

https://github.com/YuxinWenRick/tree-ring-watermark

近年はStable DiffusionやMidjourneyといった高品質の画像生成AIが相次いで登場しており、誰でも簡単にテキストから多種多様な画像を生成できるようになりました。それと同時に問題となったのが、「誰かが悪意を持ってフェイク画像を生成し、人々をだますことが簡単になった」という点です。もちろん、従来の画像加工ソフトウェアでも精巧なフェイク画像を作ることは可能ですが、テキストを入力するだけで画像を生成できるツールの登場は、そのハードルを大きく下げたといえます。

この問題に対処するために提唱されているのが、「AIが生成した画像に電子透かしを入れて識別可能にする」という仕組みです。電子透かしとは、人間が見てもわからないものの特殊な操作を行うことで検出可能なマークであり、「この画像はAIによって生成された」ということを識別するのに役立ちます。AI生成画像に電子透かしを入れる堅固な仕組みが構築・普及すれば、ソーシャルメディアや報道機関、AIプラットフォームなどが画像の出どころを特定し、フェイク画像による被害の軽減や法執行機関への情報提供が可能となります。

従来の電子透かしは、ファイルが出力された後に透かしを追加する手法が一般的です。これに対しウェン氏らの研究チームは、AIが画像を生成するプロセス自体に電子透かしのシステムを組み込む「Tree-Ring Watermarks」という手法を考案しました。

拡散モデル(diffusion model)を採用しているStable Diffusionなどの画像生成AIでは、初期値であるランダムノイズの画像から徐々にノイズを除去していくことで、最終的にきれいな画像を生成しています。Stable Diffusionなどの画像生成AIがどのような仕組みでテキストから画像を生成しているのかは、以下の記事を読むとよくわかります。

画像生成AI「Stable Diffusion」がどのような仕組みでテキストから画像を生成するのかを詳しく図解 – GIGAZINE

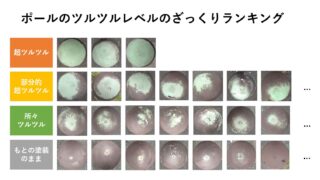

Tree-Ring Watermarksはこの画像生成プロセスのうち、初期値となるランダムノイズの配列にフーリエ変換に基づいて構築されたパターンである「キー」を組み込みます。このキーは、標準的な生成プロセスを経てランダムノイズがきれいな画像に変換されても、潜在的なレイアウトのわずかな変化として残りますが、人間がチェックしても他のランダムな生成画像と区別することができないとのこと。

しかし、キーが組み込まれた画像を拡散モデルで逆向きに処理して元のランダムノイズを復元すると、キーが存在するかどうかを確認することが可能です。キーはフーリエ空間に刻み込まれたパターンであるため、トリミングや色の変更、反転、回転、ノイズ追加といった編集に対しても既存の方法よりはるかに堅固だと研究チームは述べています。

実際に研究チームはTree-Ring Watermarksを使用した検証テストを行い、画像品質スコアへの影響が無視できる程度であることや、変換に対する高い堅牢(けんろう)性、検出における低い偽陽性率などを確認したとのことです。

デジタルコンテンツに入れる電子透かしでは、「一般的なユーザーが見ても気づかないこと」「悪意のある人物がファイルを加工しても失われないこと」「ファイルが加工されていても高い精度で検出できること」などが要求されます。Tree-Ring Watermarksはこれらの要件を達成しており、AI生成画像の出どころを追跡するのに役立つと研究チームは期待しています。

Tree-Ring Watermarksの実装にあたり新たな画像生成AIを作る必要はなく、APIを通じて既存の画像生成AIに組み込むことができるとのこと。拡散モデルの反転処理を実行するにはAIモデルのパラメータが必要なため、検証できるのは設計上AIモデルの所有者のみだそうです。

ソーシャルニュースサイトのHacker Newsでは、「サービスから何かをたどることができるなら有用です。そこにプロンプトや生成したユーザーの身元といったメタデータを詰め込めれば、児童性的虐待コンテンツから政治的な偽情報まで、あらゆるものに対抗できる強力なツールになるでしょう」というコメントが寄せられていました。

Tree-Ring Watermark: Invisible Robust Fingerprints of Diffusion Images | Hacker News

https://news.ycombinator.com/item?id=36426136

この記事のタイトルとURLをコピーする